Seagate Kinetic : une approche radicalement nouvelle pour le stockage objet

A Storage Networking World, à Francfort, LeMagIT a pu en apprendre plus sur la plate-forme de stockage objet Kinetic de Seagate. C'est peu dire qu'elle a suscité de l'intérêt...

La semaine dernière nous écrivions sur la plate-forme Kinetic OpenStorage de Seagate, dont l’objectif est de créer une nouvelle génération de disques durs à interface Ethernet intégrant des capacités de stockage objet de nature à révolutionner le stockage tel qu’on le connaît aujourd’hui. A Storage Networking World Francfort, LeMagIT a pu discuter avec Joe Fagan, le directeur senior des initiatives Cloud du constructeur pour en savoir un peu plus sur la plate-forme.

Disque dur 2.0

Pour concevoir la plate-forme Kinetic, Seagate a toute d’abord remis à plat l’interface traditionnelle du disque dur. Vu de l’extérieur un disque Kinetic est en fait un disque SAS Nearline traditionnel. Le constructeur a conservé le connecteur SAS habituel pour des raisons évidentes de praticité et de compatibilité avec la connectique existante. Mais ce connecteur n’est plus utilisé pour fournir deux ports SAS physiques mais deux ports Gigabit Ethernet. Ces deux ports peuvent être utilisés en parallèle afin de fournir plus de débit vers le disque, mais aussi pour assurer un certain niveau de redondance. En conservant le connecteur SAS, Seagate facilite l’adoption des disques Kinetic, puisqu’il ne sera pas nécessaire de redévelopper l’ensemble des backplanes permettant de connecter des disques. En fait, le contrôleur SAS devra « seulement » être remplacé par un commutateur Gigabit Ethernet redondant

Pour gérer les ports Ethernet des nouveaux disques, le contrôleur SAS traditionnel cède la place à un microcontrôleur ARM qui fournit les deux ports Ethernet, mais aussi la puissance additionnelle requise pour gérer l’intelligence du disque. Il s’agit notamment de piloter le Key/value Store intégré au disque (qui assure la correspondance entre la référence des objets et leur emplacement physique sur le disque), de supporter une pile de communication TCP/IP, mais aussi de discuter de façon plus intelligente avec la couche de middleware qui permet d’accéder aux disques (notamment pour gérer l’authentification, le placement intelligent des données sur le disque, les informations de santé…). Selon Seagate, ces modifications devraient accroitre d’une dizaine de pourcent le prix d’un disque Kinetic et augmenter légèrement la consommation électrique. Mais les bénéfices sont potentiellement immensespour les architectures de stockage objet à grande échelle.

Tout d’abord, il n’est plus nécessaire de disposer d’un ou plusieurs Xeon par serveur rack pour contrôler la douzaine de disques SAS ou SATA que l’on peut insérer dans une baie de stockage objet 2U traditionnelle.

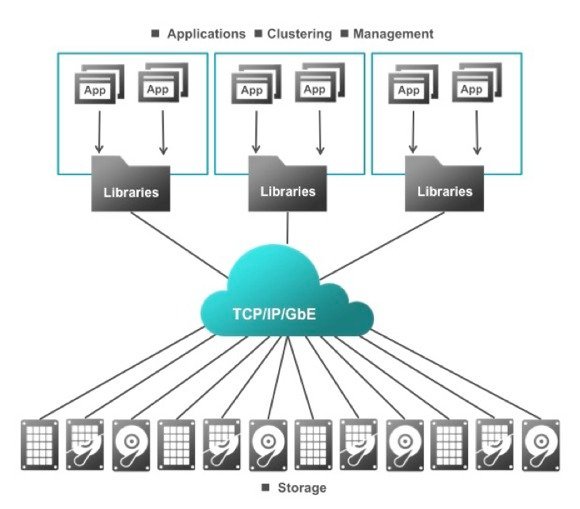

Un noeud de stockage objet dans l’architecture Kinetic se compose en fait d’un ensemble de disques Ethernet relié à un backplane doté d’un commutateur Ethernet basique et d’une alimentation électrique. Ces noeuds sont interconnectées entre eux via des commutateurs Ethernet externes pour créer un ensemble de plus haut niveau. La ressource matérielle ainsi constituée peut être accédée via un proxy (en fait un ensemble de serveurs disposant des API objets ouvertes développées par Seagate) et consommée par une couche de stockage objet de plus haut niveau (pour l’instant OpenStack Swift et Riak CS sont supportés, mais plusieurs constructeurs travaillent déjà à intégrer leur solution objet avec Kinetic). Ces couches objets de plus haut niveau gère la distribution des objets, la protection par des mécanismes comme l'erasure coding, la géodistribution et la géoréplication des objets... Elles peuvent aussi fournir des passerelles protocolaires CIFS ou NFS...

Des systèmes de stockage objets moins chers, plus performants et plus intelligents

Selon Seagate, l’architecture Kinetic a plusieurs bénéfices tangibles : tout d’abord elle va permettre de réduire considérablement le coût et la consommation électrique des systèmes de stockage objets en faisant l’économie de composants électroniques coûteux (processeurs, cartes SAS…) et en les remplaçant par des composants économiques (quelques commutateurs Ethernet, des alimentations de plus faible puissance pour les châssis disques…). Comme l’explique Joe Fagan « les serveurs de stockage deviennent inutiles et la fabric SAS disparaît, ce qui a le mérite de simplifier considérablement la pile de stockage et d’en réduire le coût ». D’ailleurs les premiers à s’intéresser à la technologie sont sans surprise les grands de l’internet, du cloud et de l’hébergement

Un autre bénéfice de cette simplification est qu’elle va permettre d’améliorer les performances des systèmes objets en supprimant un ensemble de couches protocolaires tels que les systèmes de fichiers, les protocoles SAS… Au passage, le fait que le disque gère le placement des objet et décharge le système objet d'un certain nombre d'opérations est aussi de nature à doper les performances.

Pour l’instant, les applications et systèmes objets doivent encore parler aux disques Kinetic via une couche proxy (en fait une série d’API développées par Seagate). Ces API sont fournies sous forme binaire et publiques s’intercalent entre l’application et le jeu de commande du disque. Seagate indique avoir procédé ainsi pour accélérer l’adoption de la technologie mais explique que rien n’empêche les développeurs d’accéder directement aux commandes objet de plus bas niveau du disque si ils le désirent. Joe Fagan note toutefois que si le jeu de commande des nouveaux disques est ouvert, il n’est pour l’instant pas « standard », Seagate étant le premier à avoir pensé un tel concept. Si d’autres constructeurs rejoignent le mouvement, le jeu de commande pourrait à terme se standardiser de façon plus formelle.

Des gagnants et des perdants

Si Kinetic décolle, plusieurs grands acteurs pourraient laisser des plumes dans l’offensive de Seagate. Intel notamment, dont les CPU équipent la plupart des contrôleurs de stockage et qui a beaucoup investi récemment dans la pile de stockage (notamment dans le support du SAS). Un acteur comme LSI, grand fabricant de microcontrôleurs SAS pour l’industrie du disque dur et pour les systèmes de stockage, pourrait aussi perdre beaucoup dans l’opération. Seagate de son côté a tout à gagner : depuis des années, les disques durs ont été relégués au rang de vulgaires composants interchangeables avec une course sans fin au rapport capacité/prix. Avec une innovation comme Kinetic, Seagate remet le disque dur au centre des systèmes de stockage. Un autre gagnant potentiel est ARM. Car chaque disque Kinetic embarque un microcontrôleur ARM un peu plus performant que le Microcontrôleur standard d’un disque. Et c’est l’utilisation d’un de ces contrôleurs sur chaque disque qui permet de faire l’économie d’un Xeon dans les systèmes de stockage. Comme quoi la bataille entre ARM et x86 se fait sur tous les terrains de l’informatique…